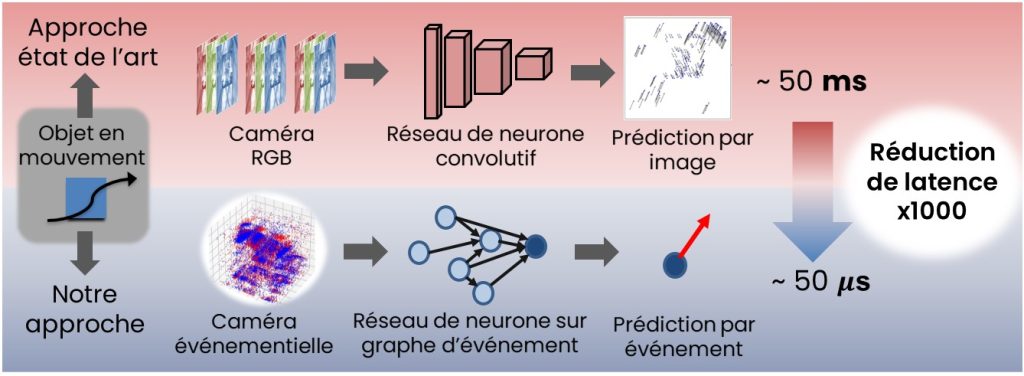

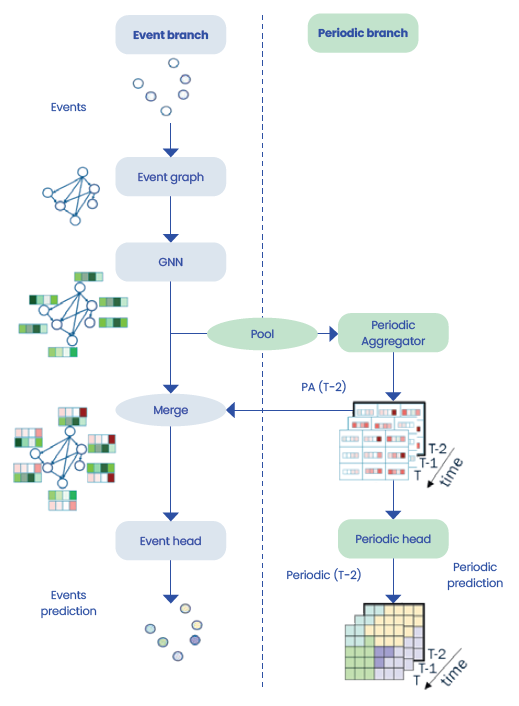

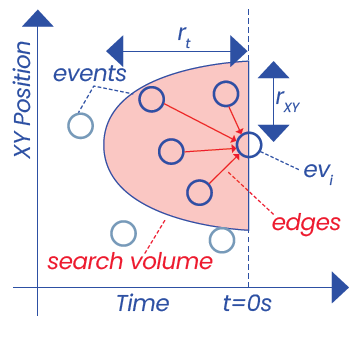

Les systèmes de vision par ordinateur nécessitent une haute précision temporelle, notamment pour la navigation autonome ou la stabilisation vidéo. Les méthodes traditionnelles, basées sur des images RGB, sont limitées par leur coût calculatoire élevé et la fréquence d’acquisition des images. Les caméras événementielles offrent une alternative prometteuse grâce à leur fonctionnement asynchrone et leur haute résolution temporelle. Cependant, les méthodes actuelles reposant sur des réseaux convolutifs recréent des images à partir des événements, perdant ainsi leur avantage en termes de latence et restant trop coûteuses pour des systèmes embarqués.

|

|

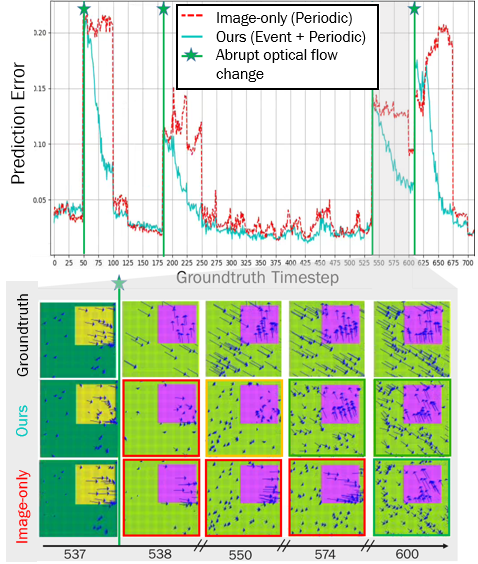

Notre approche réduit la latence de détection des changements de vitesse, avec une prédiction par événement en 50 µs sur matériel embarqué, soit 1 000 fois plus rapide que les solutions classiques. De plus, elle nécessite 17 fois moins de paramètres et 48 fois moins d’opérations par seconde, tout en maintenant une précision compétitive.

Notre approche ouvre la voie à des capteurs intelligents très faible latence et économes en énergie pour la vision embarquée.