L’intelligence artificielle (IA) générative visuelle est aujourd’hui utilisée pour la création de contenu artistique, l’édition et la restauration d’image. Elle fournit également aux systèmes d’IA existants davantage de données pour s’entraîner et créer des algorithmes plus performants. Depuis 2020, elle a fortement progressé grâce aux modèles dits « de diffusion » permettant de créer des images très réalistes à partir d’instructions textuelles. Des services très populaires ont été construits sur ces modèles. Cependant, s’il existe des métriques pour évaluer le réalisme du rendu des images générées, peu de travaux se sont intéressés au respect de la consigne.

Les IA génératives visuelles de diffusion sont entraînées à partir d’une masse d’images réelles accompagnées d’une description textuelle et auxquelles un fort effet de grain a été appliqué. L’IA apprend à « débruiter ces images », et ainsi à extrapoler une image à partir de données limitées. Après cette phase d’entraînement, le système va, à partir d’une consigne textuelle (le “prompt”) générer un bruit aléatoire et « halluciner » une image nouvelle, construite de toutes pièces, au sein du bruit.

Toutefois, on constate qu’une IA générative peut créer des images qui ne respectent pas précisément le prompt. En effet, si une liste d’objets et des propriétés (comme des couleurs) lui sont données, il peut inverser les attributs, voire omettre un objet. Par exemple, à partir d’une consigne « un chat noir et une voiture bleue », il peut créer un chat bleu et une voiture noire ou seulement un chat noir. Des expérimentations suggèrent que plus le prompt est complexe, plus les erreurs sont fréquentes, contrairement à la qualité visuelle qui elle, n’est pas affectée.

Pour mieux évaluer ces limitations, le CEA-List a développé TIAM (Text-Image Alignment Metric), une métrique innovante qui mesure le respect de la sémantique des consignes d’une IA visuelle générative.

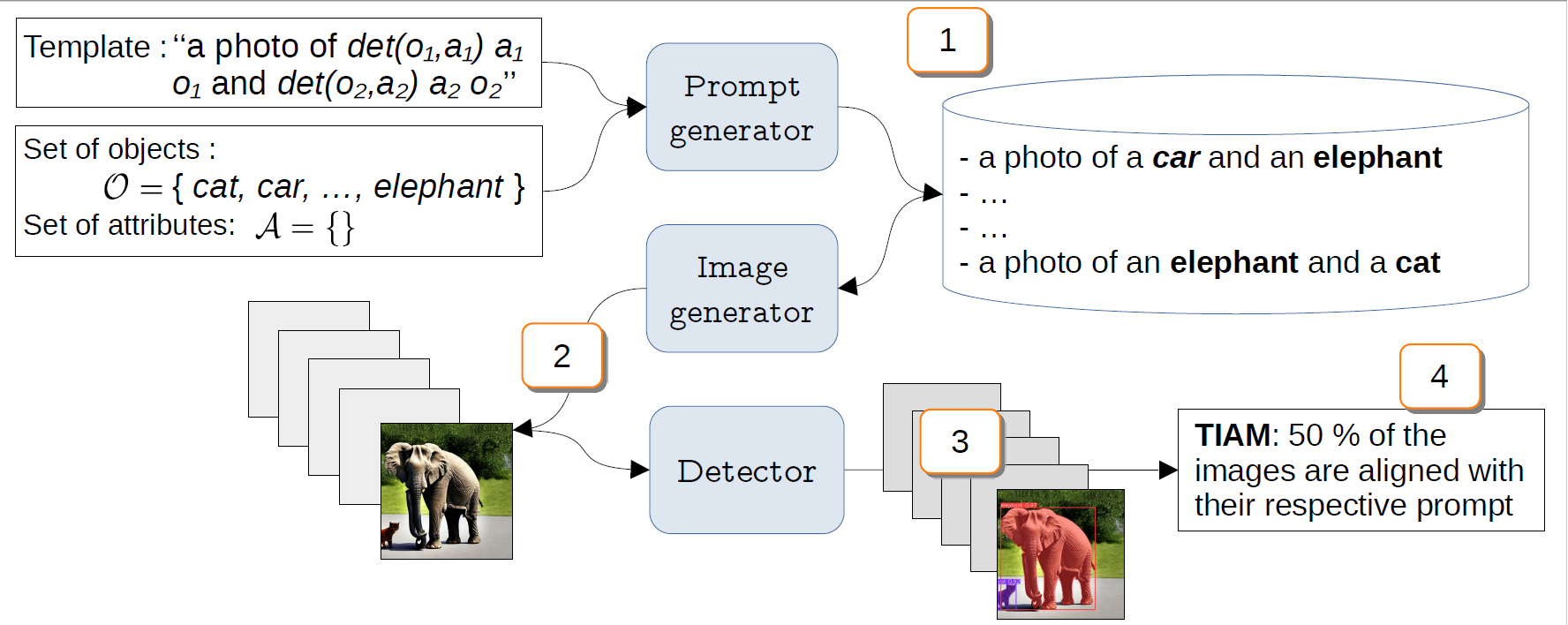

La métrique TIAM procède en plusieurs étapes. Elle part d’une liste d’objets et d’attributs associée à une consigne générique, une sorte de « texte à trous », par exemple : “une photo de (objet : chat) (attribut : noir) et de (objet : voiture) (attribut : bleu)”. Ce patron permet de générer massivement des prompts où les objets sont clairement liés à leurs attributs. Un certain nombre d’images est alors généré pour chaque consigne, une autre IA détectant ensuite la présence des objets et vérifiant le respect de l’attribut. Enfin, la métrique compare les résultats de détection à la structure de la consigne pour quantifier le respect moyen des prompts.

TIAM a permis de comparer la correspondance entre les consignes et les images générées par 6 modèles d’IA existantes (4 versions de Stable Diffusion (1.4, 1.4 A&E, 2, 2 A&E), un équivalent libre de Dall-E (OpenAI) et de Imagen (Google)). Les IA évaluées ont montré que les capacités à respecter un prompt s’effondraient dès lors que celui-ci devenait un peu plus complexe (plus de deux objets par exemple, ou bien deux objets avec des couleurs différentes spécifiées). En effet, sur la base d’un échantillon de 24 objets différents, a été évalué le score de correspondance, pour la requête d’un seul objet, puis pour la requête de toutes les combinaisons de deux objets distincts ; ce score a été supérieur à 95% (de 95% à 99% selon les modèles) pour un objet, tandis qu’il a chuté de 65% à 41%, selon les modèles, pour deux objets1.

La métrique TIAM pourra aider à mieux comprendre l’influence des paramètres d’entraînement des IA sur la compréhension et le respect des consignes. Son développement a également permis l’observation d’un phénomène surprenant : certains choix de bruit à la source de la génération d‘image étaient systématiquement associés à de meilleures performances, même pour des nouveaux objets. Les travaux du CEA-List ouvrent donc une nouvelle voie de recherche sur le noise mining, c’est-à-dire la quête des “bons” bruits qui augmentent la qualité des résultats d’une IA.

La publication des résultats de nos travaux réaffirme la présence, la maîtrise, la responsabilité et la capacité d'innovation du CEA-List dans le domaine de l’IA générative visuelle.